Bonjour,

Ma question a peut-être déjà été débattue, mais ma capacité à faire des recherches sous un forum est assez … restreinte ![]()

J’ai fais une terrible erreur avec mon réseau zigbee (changement de canal à l’arrache, les esclave zigbee qui ne suivent pas … c’est le foutoir !) et tant qu’à tout remettre sur pied, j’aimerais quelques conseils.

Actuellement j’ai une clef SONOFF ZigBee 3.0 USB Dongle Plus, une cinquantaine de périphériques dont 50% environ sont des routeurs. Un broker MQTT sur une machine virtuelle dans un coin, Z2M intégré à Home Assistant. Cela ne se passait pas trop mal ces derniers temps, une petite latence pour certains périphériques. Par contre, l’ajout de nouveaux modules commence à devenir pénible, j’ai des sondes qui “disparaissent” de temps en temps …. bref, il doit y avoir quelques perturbations. D’où la boulette : le changement de canal.

Du coup, je me pose plein de question :

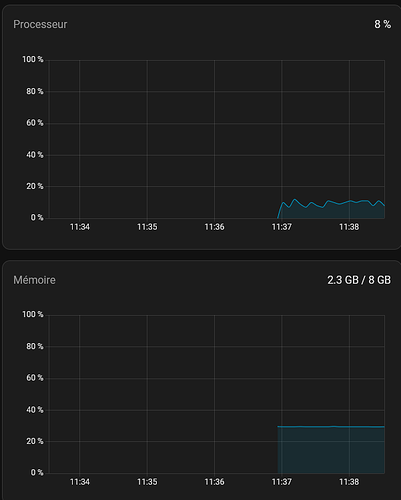

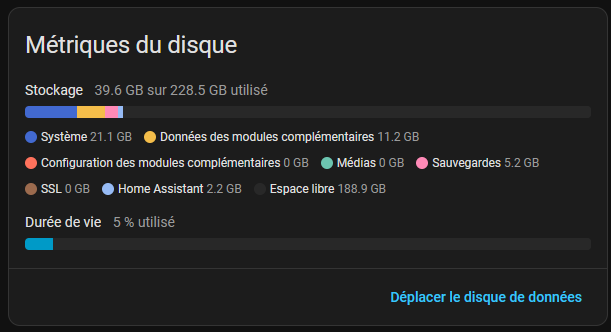

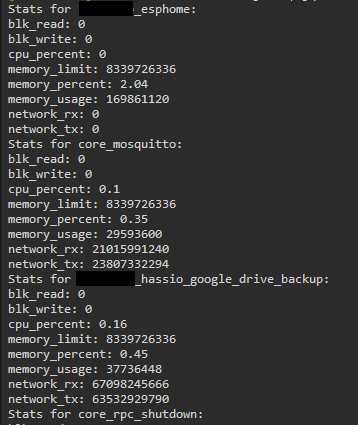

- Est-ce que séparer les fonctions est une bonne idée : 1 serveur MQTT, un serveur Z2M, un serveur Home assistant (j’ai la chance d’avoir quelques mini PC qui peuvent servir de serveurs et de paravirtualiseurs. Si je mets ça sur plusieurs VM mais sur la même machine, le trafic réseau sera quasi inexistant, donc les latences dûes au réseau maitrisées.

- Ou est-il préférable de gonfler la machine Home assistant et de lui coller toutes les intégrations et add-on (perso, je ne suis pas trop pour, mais je cherche d’autres avis)

- Ou alors, changer de clef USB pour passer sur un modèle Ethernet, avec serveur Z2M et MQTT intégré … J’e ne suis pas trop chaud non plus (j’ai du matériel qui fonctionne, autant l’utiliser, sauf si vous me dites que c’est mort et que ma clef est dépassée

)

)

Bon, il y a déjà 2-3 choses de prévues:

- Achat d’une rallonge USB blindée pour écarter la clef Zigbee des serveurs

- Mise à jour du firmware (je l’ai fait au tout début, lorsque j’ai acheté la clef, il y a peut-être une mise à jour de dispo, à voir).

Par contre, revenir à quelque chose “à plat” va avoir comme conséquence de devoir réappairer tous les appareils. Bon, je me suis fait une raison, on fera avec.

Mais quid de toutes les automatisations ? Là par contre, je commence à avoir pas mal de trucs, ça m’embêterais de devoir tout me retaper à la mains…

Bref, pas grand chose, voyez ça comme un cadeau de Noël ![]()

Et à ce sujet, bonne fêtes à toutes et tous !