Bonjour à toute la commu HACF ![]()

Je fais ce post aujourd’hui pour demander de l’aide concernant un soucis très précis que je rencontre avec un de mes derniers projets en lien avec Home Assistant.

Un peu de contexte:

Depuis plusieurs mois, mon HA tourne correctement et j’y apporte pas mal de modifications en fonction de mes besoins, mais dans la globalité tout fonctionne bien, sauf 1 truc…

J’ai un Home assistant accessible en HTTPS depuis n’importe ou via une connexion externe bricolée moi même à base de reverse proxy et de DNS Cloudflare qui fonctionne parfaitement bien.

Mais de ce fait, je ne peux pas bénéficier de la liaison prévue native avec Alexa via Nabu Casa donc comme beaucoup, j’ai ouvert les consoles AWS et Alexa Developer, copié collé quelques lignes de code et magie j’ai une SKILL Home Assistant qui fonctionne !

Ne me faites pas dire ce que je n’ai pas dit, ce setup fonctionne bien, excepté que Alexa est bizarrement, comment dire… EXCEPTIONELLEMENT STUPIDE !?

J’ai plus souvent des « Je ne sais pas ce qu’il s’est passé » ou « Je ne peux pas répondre a votre question » que autre chose.

BREF, pour allumer ou éteindre quelques lampes c’est cool, mais on est loin de la panacée d’un assistant IA un minimum intelligent…

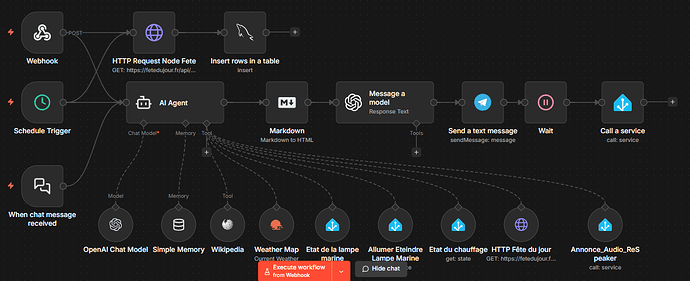

D’où mon dernier projet (oui enfin on y vient…), la remplacer par une IA locale qui serait capable de converser avec moi et ma famille, m’apporter des réponses a des questions plus complexes, mettre des timers, etc… tout en contrôlant mon Home Assistant.

En somme, je veux un vrai JARVIS / Majordome informatique pratique et intelligent à utiliser au quotidien ![]()

Le Soucis

J’ai pour parvenir à ce but suivi quelques tutos, fais quelques recherches et tenté un déploiement de QWEN2.5-7B via OLLAMA sur mon ancien PC gaming (pour bénéficier de la puissance de calcul du GPU) et a ma grande surprise, j’ai réussi ![]()

Mais lorsque j’ajoute l’extension Ollama à Home assistant et que je commence à converser avec via Assist, je me rends compte que l’IA à du mal à identifier mes entités, reconnaitre et allumer / éteindre des groupes de lumières, se souvenir de différents détails etc..

EXEMPLES CONCRETS:

- Je lance une conversation Assist ou je demande à l’IA de rajouter mes lampes « Mur 1, Mur 2, Mur 3 & Mur 4 » au groupe « MUR » puis je lui demande d’allumer le mur. Elle allume bien toute les lampes. Je ferme la page et réouvre une nouvelle conversation Assist, et le groupe MUR à disparu elle ne le connais plus…

- Je lui demande de changer la couleur de mon ampoule tuya « Mets la lampe bureau en vert » et l’IA me dit que elle change la couleur, mais la couleur ne change pas. Par contre si je lui demandes d’éteindre la lampe bureau, ma lampe s’éteint bien ! Donc elle sait communiquer avec mais pas changer sa couleur ?!

- j’ai un module sonoff flashé avec ESP home qui contrôle une bande led encastrée dans mon armoire de la cuisine, j’ai cree sur cet noeud esp un sensor qui s’appelle « ESP-armoire-cuisine-relai » qui fait partie de l’appareil « ESP-Armoire-cuisine », malgré que j’ajoute manuellement l’appareil ESP-Armoire-Cuisine à la pièce cuisine, l’IA refuse de l’allumer avec mes autres lampes présentes dans le groupe de la pièce.

- L’IA ne retiens pas nos précédentes conversations, j’ai l’impression que je parle avec un mauvais chatbot de service client qui se reset à chaque update de page…

BREF, je ne vois aucune intelligence de la part de l’IA et je suis loin du majordome qui apprends s’adapte et s’imprègne de ma vie, mes habitudes, et qui peut faire en sorte que ma maison devienne vraiment autonôme.

Ma question

Y a t’il parmi vous quelqu’un qui s’y connais en termes d’IA qui pourrais me donner des tuyaux sur comment faire pour que je puisse avoir réellement un JARVIS à la maison, comme si il y avait constatent un type chez moi qui est capable de faire exactement ce que je lui demande, qui apprends de mes actes et de ceux de ma famille, et qui devient au fur et à mesure vraiment utile ?

J’aimerais entre autre que cette IA sache :

- Reconnaitre qui parle dans le micro pour adapter les actions et les réponses

- Créer des habitudes pour que quand l’IA remarque que je me lave tout les soirs à 18H, elle allume le chauffage en prévoyance à 17H30.

- Sache modifier mon HA de sorte que quand je lui demande d’ajouter une lampe à une pièce elle le fasse, ou que quand je lui demande d’automatiser une action elle crée cette dernière dans HA.

- etc…

N’hésitez pas à me dire si j’ai été asser clair dans mes explications ou si vous avez besoin de plus de détails ![]()

Mais je vous avoue que j’arrive à bout des solutions que ChatGPT et Deepseek me recommandent, j’ai été jusqu’à crée un « orchestrateur » en Python qui servirait de point d’entrée pour les requêtes IA et que c’est ce dernier qui gérerai la mémoire etc… Bref c’étais un bordel sans non et beaucoup trop complexe pour mes capacités ( JE NE SUIS PAS DEV ![]() ) !

) !

Merci à toutes et a tous d’avoir lu <3

Ma configuration

System Information

| version | core-2026.3.1 |

|---|---|

| installation_type | Home Assistant OS |

| dev | false |

| hassio | true |

| docker | true |

| container_arch | amd64 |

| user | root |

| virtualenv | false |

| python_version | 3.14.2 |

| os_name | Linux |

| os_version | 6.12.67-haos |

| arch | x86_64 |

| timezone | Europe/Brussels |

| config_dir | /config |

Home Assistant Community Store

| GitHub API | ok |

|---|---|

| GitHub Content | ok |

| GitHub Web | ok |

| HACS Data | ok |

| GitHub API Calls Remaining | 5000 |

| Installed Version | 2.0.5 |

| Stage | running |

| Available Repositories | 2898 |

| Downloaded Repositories | 4 |

Home Assistant Cloud

| logged_in | false |

|---|---|

| can_reach_cert_server | ok |

| can_reach_cloud_auth | ok |

| can_reach_cloud | ok |

Home Assistant Supervisor

| host_os | Home Assistant OS 17.1 |

|---|---|

| update_channel | stable |

| supervisor_version | supervisor-2026.03.2 |

| agent_version | 1.8.1 |

| docker_version | 29.1.3 |

| disk_total | 30.8 GB |

| disk_used | 16.6 GB |

| nameservers | 10.0.0.1, 192.168.1.1, 109.88.203.3 |

| healthy | true |

| supported | true |

| host_connectivity | true |

| supervisor_connectivity | true |

| ntp_synchronized | true |

| virtualization | vmware |

| board | ova |

| supervisor_api | ok |

| version_api | ok |

| installed_addons | MariaDB (2.7.2), Terminal & SSH (10.0.2), ESPHome Device Builder (2026.3.0), Mosquitto broker (6.5.2), Studio Code Server (6.0.1), Matter Server (8.2.2), Zigbee2MQTT (2.9.1-1) |

Dashboards

| dashboards | 5 |

|---|---|

| resources | 4 |

| views | 8 |

| mode | storage |

Network Configuration

| adapters | lo (disabled), enp3s0 (enabled, default, auto), hassio (disabled), docker0 (disabled), veth729d20a (disabled), veth8676dbf (disabled), veth2e88bf3 (disabled), vetheccd00f (disabled), veth50fc2af (disabled), veth4af11c0 (disabled), veth15f8d97 (disabled), vethcd40e30 (disabled), vethd6253c4 (disabled), veth24f8a14 (disabled), vethe5864a3 (disabled) |

|---|---|

| ipv4_addresses | lo (127.0.0.1/8), enp3s0 (10.0.1.102/16, 10.0.1.102/24, 192.168.1.102/24), hassio (172.30.32.1/23), docker0 (172.30.232.1/23), veth729d20a (), veth8676dbf (), veth2e88bf3 (), vetheccd00f (), veth50fc2af (), veth4af11c0 (), veth15f8d97 (), vethcd40e30 (), vethd6253c4 (), veth24f8a14 (), vethe5864a3 () |

| ipv6_addresses | lo (::1/128), enp3s0 (fe80::5283:8cb4:11a4:863a/64), hassio (fe80::8e2:34ff:fe99:72dd/64), docker0 (fe80::d411:c9ff:fef8:dd5f/64), veth729d20a (fe80::a03d:b7ff:fe22:b6cc/64), veth8676dbf (fe80::ccf2:82ff:fef4:4c5a/64), veth2e88bf3 (fe80::503b:76ff:fec5:7f32/64), vetheccd00f (fe80::48db:f2ff:febb:a77a/64), veth50fc2af (fe80::d4c0:62ff:fe1d:bc15/64), veth4af11c0 (fe80::fc2d:76ff:fe06:daca/64), veth15f8d97 (fe80::3841:dfff:fe35:917d/64), vethcd40e30 (fe80::3099:7ff:fe75:426/64), vethd6253c4 (fe80::d022:91ff:fe07:24a3/64), veth24f8a14 (fe80::bc77:2ff:fee8:9fff/64), vethe5864a3 (fe80::e434:bbff:fefb:5fb2/64) |

| announce_addresses | 10.0.1.102, 10.0.1.102, 192.168.1.102, fe80::5283:8cb4:11a4:863a |

Recorder

| oldest_recorder_run | 7 mars 2026 à 14:42 |

|---|---|

| current_recorder_run | 21 mars 2026 à 19:42 |

| estimated_db_size | 102.31 MiB |

| database_engine | sqlite |

| database_version | 3.49.2 |

Spotify

| api_endpoint_reachable | ok |

|---|